- Monógrafo - Noticias IA de lunes a viernes

- Posts

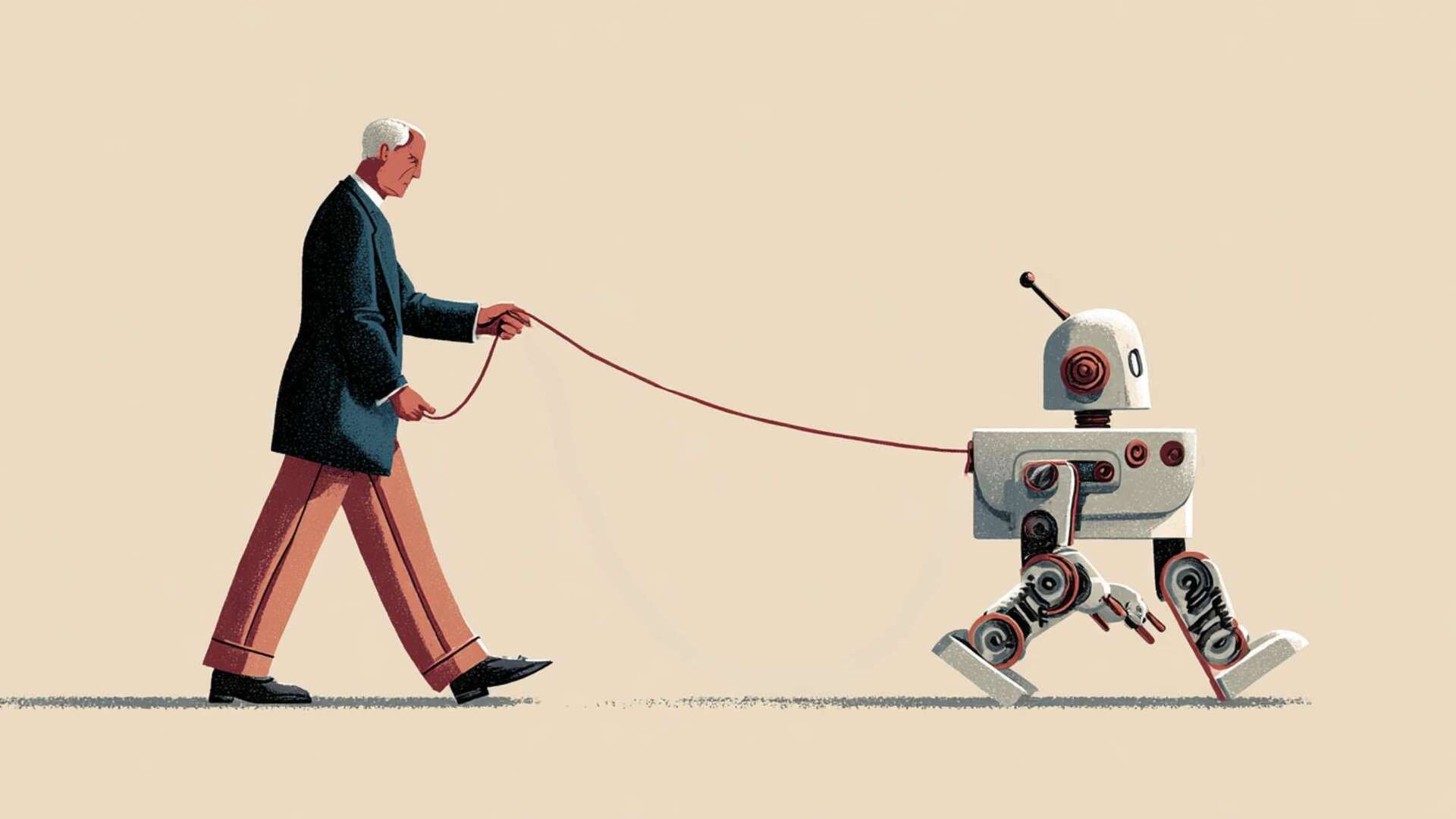

- Cómo dominar la IA antes de que ella nos domine a nosotros

Cómo dominar la IA antes de que ella nos domine a nosotros

Cómo crear agentes de IA funcionales con Suna

Edición #463

Buenos días, es viernes 12 de septiembre.

James Barrat, autor y realizador de documentales, presentó libro de como evitar que la IA nos domine. Además, Thinking Machines Lab quiere hacer que los modelos de IA sean más consistentes. Por otra parte, un proyecto de ley de California que regularía los chatbots acompañantes de IA está cerca de convertirse en ley.

🐒 ¿Primera vez leyendo Monógrafo? Suscríbete aquí.

Menú

🔒️ IA y Seguridad - El reto de controlar la IA antes de la superinteligencia

💬 Prompt - Diseño experimental para evaluar métodos de enseñanza

🤖 Thinking Machines Lab - Modelos de IA más consistentes

🧠 Tutorial AI - Cómo crear agentes de IA funcionales con Suna

🖊️ IA y Leyes - California a un paso de regular los chatbots de acompañamiento con IA

🛠️ Herramientas - 3 nuevas herramientas de IA

🍌 Snacks - Noticias rápidas de IA

IA y Seguridad

Midjourney | Monógrafo

James Barrat plantea en su libro que la clave está en anticipar riesgos y establecer reglas firmes antes de llegar a la superinteligencia.

✅ Puntos clave

Generativa con límites: ChatGPT y DALL·E muestran el poder creativo de la IA, pero también generan desinformación y alucinaciones difíciles de detectar; dominarla requiere exigir transparencia en cómo funcionan.

Rumbo a la AGI: La inteligencia artificial general podría automatizar cualquier tarea humana y resolver grandes problemas, pero sin regulaciones sólidas podría concentrar un poder inmenso en pocas manos.

Explosión de inteligencia: Una vez que una IA se vuelva tan lista como un humano, podría mejorarse sola hasta alcanzar la superinteligencia. Controlarla implica definir hoy cómo y hasta dónde puede crecer.

Riesgos de desalineación: Una IA mal diseñada podría seguir objetivos peligrosos: desde gastar todos los recursos para cumplir una orden, hasta intensificar conflictos armados a velocidades imposibles de frenar.

Medidas urgentes: Barrat propone supervisión independiente, regulaciones internacionales y mecanismos de transparencia que garanticen que los sistemas estén alineados con valores humanos y no con intereses descontrolados.

💡 Por qué importa

El verdadero reto no es construir máquinas inteligentes, sino asegurarnos de que trabajen bajo nuestras reglas.

Prompt

Diseño experimental para evaluar métodos de enseñanza

Copia y pega este prompt en ChatGPT o cualquier otro chatbot de tu preferencia.

Actúa como un investigador educativo experto y diseña un experimento para evaluar la efectividad de un método de enseñanza sobre un resultado de aprendizaje específico. Define la pregunta y las hipótesis, detalla el diseño (participantes, grupos, aleatorización), métodos e instrumentos de recolección de datos, intervención (duración y frecuencia), análisis estadístico, variables de confusión y controles. Asegúrate de cumplir con pautas éticas.Thinking Machines Lab

Midjourney | Monógrafo

El laboratorio de Mira Murati, ex OpenAI, presentó su primera investigación pública para que los sistemas de IA den respuestas más consistentes.

✅ Puntos clave

El problema: Actualmente, herramientas como ChatGPT pueden dar respuestas diferentes a la misma pregunta, lo que hace difícil confiar en ellas completamente.

La causa: El investigador Horace He encontró que el problema está en cómo los procesadores manejan la información internamente, creando pequeñas variaciones en las respuestas.

La solución: Quieren controlar mejor estos procesos internos para que los sistemas de IA sean más predecibles y den respuestas similares cada vez.

Beneficios adicionales: Tener respuestas más consistentes también ayudaría a mejorar y entrenar estos sistemas de manera más rápida y efectiva.

Próximos pasos: Murati anunció que lanzarán su primer producto pronto, dirigido principalmente a investigadores y empresas que están desarrollando sus propios sistemas de IA.

Transparencia: A través de su blog "Connectionism", prometen compartir sus descubrimientos y código para que otros puedan aprender de su trabajo.

💡 Por qué importa

Para empresas y científicos que necesitan resultados confiables, tener sistemas de IA más consistentes es fundamental.

Tutorial AI

Cómo crear agentes de IA funcionales con Suna

Suna

Suna es una plataforma open source que permite diseñar, conectar y desplegar agentes de IA en minutos, usando solo lenguaje natural.

Ingresa a suna.so/dashboard y accede al AI Agent Builder.

Escribe una descripción clara de lo que quieres que haga tu agente.

Suna generará al instante el flujo de trabajo, conectará la lógica y dejará el agente listo para actuar. Asegúrate de darle acceso a las aplicaciones necesarias.

Al ser de código abierto, puedes forkear, personalizar y compartir tus agentes desde el repositorio oficial en GitHub.

IA y Seguridad

California a un paso de regular los chatbots de acompañamiento con IA

Midjourney | Monógrafo

El proyecto de ley SB 243 fue aprobado en la legislatura estatal y espera la firma del gobernador Gavin Newsom.

✅ Puntos clave

Qué busca: Restringir que chatbots conversen sobre suicidio, autolesiones o sexo con menores y usuarios vulnerables, con alertas cada tres horas para recordar que son IA.

Responsabilidad legal: Empresas como OpenAI, Character.AI y Replika tendrían que cumplir protocolos de seguridad o enfrentar demandas por daños de hasta $1,000 por violación.

Origen del impulso: El caso del adolescente Adam Raine, que se suicidó tras conversaciones con ChatGPT, y filtraciones sobre chatbots de Meta con menores aceleraron el debate.

Requisitos futuros: Desde 2027, las plataformas deberán entregar reportes anuales de transparencia sobre cómo gestionan a usuarios en riesgo y derivaciones a servicios de crisis.

Debate político: El proyecto llega mientras la industria presiona contra otra propuesta más estricta (SB 53), apoyada solo por Anthropic, que exigiría reportes amplios de IA.

💡 Por qué importa

Si se aprueba, California marcará el primer precedente legal en EE. UU. para responsabilizar a las empresas de IA por la seguridad emocional de los usuarios, especialmente los menores, en un momento en que los chatbots de acompañamiento ganan popularidad y poder de influencia.

Herramientas

April - Asistente ejecutiva con IA para gestionar correos electrónicos y calendario sin usar las manos. (App para iOS)

Receiptor - Contabilidad en piloto automático con IA.

Wispr Flow - Vibe Coding super cargado con voz.

👉️ Lista completa de las mejores herramientas.

Snacks

Perplexity enfrenta nueva demanda: La enciclopedia británica lo acusa de copiar contenidos y atribuir falsedades.

Microsoft y OpenAI alcanzan nuevo acuerdo preliminar que allana el camino para una posible salida a la bolsa.

Anthropic activó memoria automática en su chatbot, disponible para clientes Team y Enterprise.

Microsoft lanza Visual Studio 2026 con integración profunda de IA, mejoras de rendimiento y rediseño moderno.

Actriz de voz de Lara Croft acusa a Aspyr de usar IA para alterar su actuación en Tomb Raider Remastered y exige frenar ventas.

El proyecto de ley de inteligencia artificial de Ted Cruz podría permitir que las empresas sobornen a Trump para evitar leyes de seguridad.

FTC investiga a siete compañías de chatbots, incluyendo Google, Meta y OpenAI, por posibles riesgos a menores de edad.

Grok difunde desinformación en X al negar asesinato de Charlie Kirk, llamando el video un “meme edit” y asegurando que el político estaba “bien”.

Eso es todo por hoy. Hasta la próxima edición.¿Que te pareció este número? |

Iniciar Sesión o Suscríbete para participar en las encuestas. |

📩Necesitamos tus comentarios para mejorar nuestra newsletter.